Un algorithme est une succession finie d’opérations ordonnées dont la mise en œuvre permet de résoudre un problème. Présenté comme ceci, un algorithme n’est pas limité à l’informatique. Cela peut être une recette de cuisine ou une démonstration mathématique. Toutefois, lorsque l’on parle d’algorithmes dans le langage courant, on pense surtout à des programmes informatiques. Dans ce cadre-là, il s’agit d’une suite finie d’opérations qui sont regroupées dans un programme informatique qui sera mis en œuvre par un ordinateur. On commence déjà à parler d’intelligence artificielle dans les années 1950 avec le développement d’algorithmes qui tentent de réaliser des fonctions cognitives de haut niveau et dont on considère que la réalisation signale une forme d’intelligence qui se rapproche de l’intelligence humaine (par exemple, être capable de produire un texte compréhensible ou de gagner un jeu plus ou moins complexe). Les premiers dispositifs « intelligents » qui pénètrent la société prennent la forme de systèmes experts. Ces systèmes sont la traduction en langage informatique de la base de connaissance d’un expert d’un domaine spécifique. La forme la plus simple est celle d’une arborescence décisionnelle : si la condition A est remplie, l’algorithme prend la décision 1 ; si elle n’est pas remplie, l’algorithme prend la décision 2 ; et ainsi de suite.

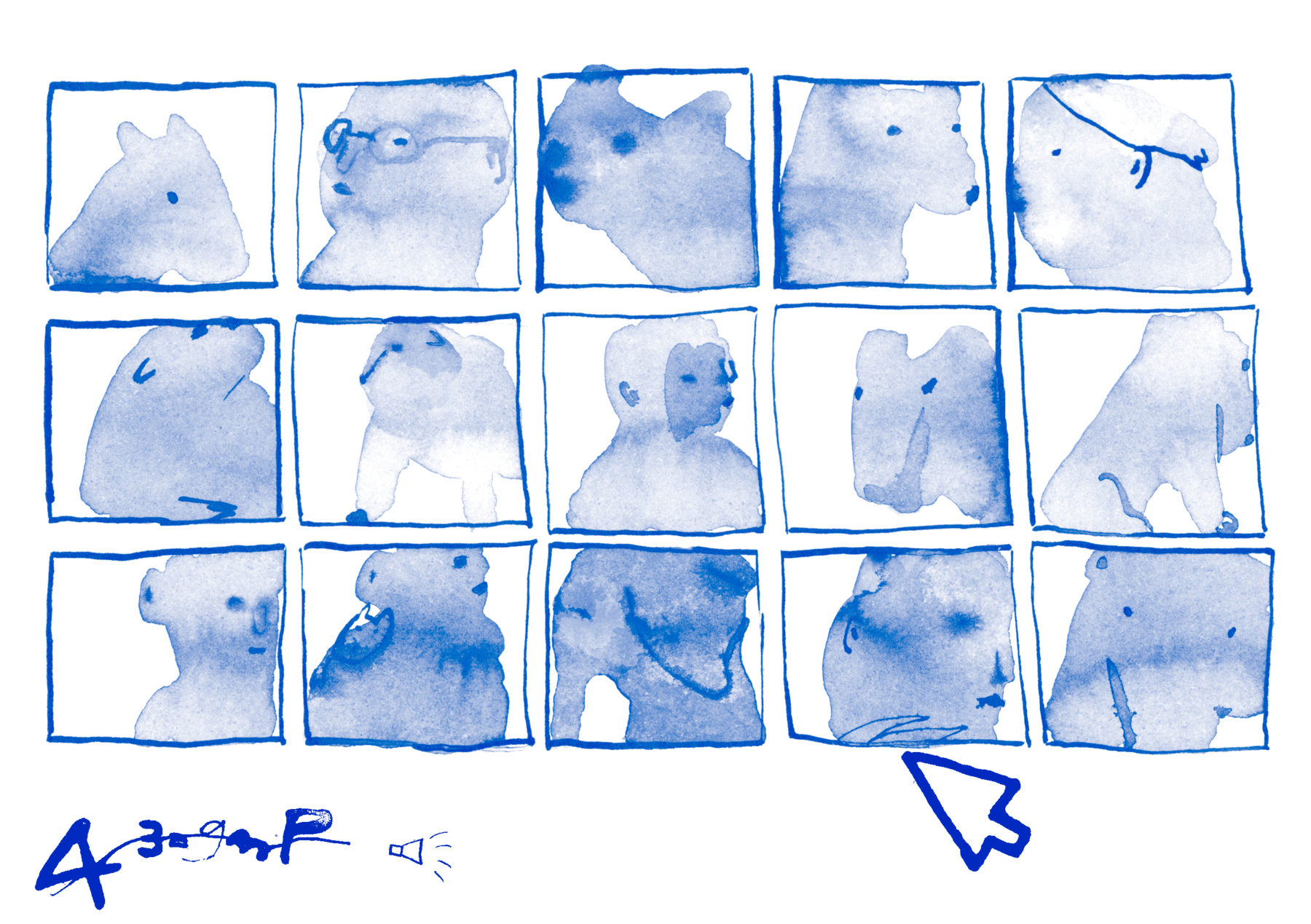

Ces « intelligences artificielles » sont assez peu flexibles et ne peuvent pas prendre de décisions dans des domaines qui ne sont pas pris en compte lors de la rédaction de leur programme. On privilégie aujourd’hui des systèmes dits « apprenants ». Ces systèmes ingèrent des données d’entrainement qui vont permettre d’automatiser la prise de décision sans pour autant qu’il faille décrire explicitement l’ensemble des règles à suivre. Ces données d’entrainement prennent la forme de grandes listes annotées. Pour illustrer cet « apprentissage », prenons l’exemple d’un algorithme qui doit identifier des animaux au sein d’une suite d’images. Les données d’entrainement prendront la forme d’une liste d’images d’exemple et annotées de labels décrivant les animaux présents dans l’image. À force de comparer plusieurs dizaines de milliers d’exemples, le système va progressivement identifier la récurrence de certaines configurations visuelles (la position et la couleur de pixels) en fonction du label « chiens », « chats », etc. Cette intelligence artificielle est donc une grande machine statistique capable d’observer et de retenir des relations statistiques complexes. Nous sommes donc loin d’une compréhension « humaine ».

Ces récurrences statistiques peuvent être identifiées au sein de médias divers : images, pistes sonores, base de données chiffrées, textes, etc. Les algorithmes de recommandations qui déterminent l’ordonnancement des publications sur des réseaux sociaux (Instagram ou TikTok par exemple) mobilisent également ces techniques d’apprentissage, si ce n’est que celui-ci porte sur des données retraçant le comportement des utilisateurs. Étant donné que ces technologies vont essayer de maximiser « l’engagement » de l’utilisateur (l’intensité de son interaction avec le système à travers des clics, des commentaires, des likes etc.), l’observation des historiques de navigation va permettre d’identifier quels sont les types de contenus avec lesquels l’utilisateur tend à interagir. Pour faire le parallèle avec l’exemple précédent, les contenus consultés composent la base de données d’entrainement tandis que le comportement de l’utilisateur vis-à-vis de ce contenu est l’annotation. À terme, l’observation d’une grande quantité de traces de navigation parmi un grand ensemble d’utilisateurs permet de prédire quels sont les contenus qui génèrent plus ou moins d’interaction en fonction du profil d’un utilisateur.

Biais algorithmiques

Un problème majeur qui est souvent relevé dans les médias concerne les biais de ces décisions algorithmiques et plus précisément, les biais issus de cette phase d’apprentissage. Reprenons notre algorithme de reconnaissance d’image sauf que nous souhaitons qu’il puisse également identifier des visages d’êtres humains. C’est ce qu’a mis en place Google en 2015 avec l’intégration d’un algorithme permettant de décrire des images via leur application photo. Malheureusement, cet algorithme s’est mis à labelliser des personnes à la peau noire en tant que « gorilles ». Que s’est-il passé ? Cette erreur, devenue depuis un cas d’école, est issue de la surreprésentation de personnes blanches dans les données d’entrainement et, par conséquent, l’absence d’un nombre suffisant de photos incluant des personnes d’origines diverses. Dans l’attente d’une solution à long terme, Google a décidé de brider son outil pour qu’il ne puisse plus attribuer de labels de primates, quelle que soit l’image soumise.

Des biais peuvent également découler des annotations appliquées aux données d’entrainement lorsque la labellisation implique de catégoriser des phénomènes sociaux qui ne se laissent pas facilement capturer au sein de structures rigides. L’identification de l’« érotisme » d’une image est un enjeu crucial pour de nombreuses entreprises numériques qui doivent modérer les contenus publiés sur leurs plateformes pour satisfaire leurs annonceurs. Apprendre à un algorithme à identifier cet « érotisme » implique de labéliser des images d’entrainement et de figer le niveau d’érotisme de chaque image. Or, ce travail d’annotation est une tâche interprétative qui est dépendante du profil des annotateurs humains.

Ces trous dans les données d’entrainement ou ces choix de labellisations sont autant de régularités statistiques auxquelles ces technologies sont sensibles. Qu’elles découlent de discriminations sociales néfastes n’a que peu d’importance pour ces dispositifs qui peuvent ensuite automatiser leur reproduction à grande échelle. Reconnaissance faciale, attribution de crédits et assurances, screening de CV, décisions de justice sont autant de domaines d’applications à risque.

Critiquer les biais de ces algorithmes implique donc de s’interroger sur les conditions de production de ces données et des rapports de pouvoirs qui précèdent leur construction. Corriger ces biais pour rendre ces technologies socialement acceptables est une possibilité sérieusement explorée par de nombreux chercheurs. Toutefois, bien qu’engageante, cette perspective ne nous offre qu’un champ de vision bien étroit. Il est encore incertain qu’il soit possible de prédire et de corriger ces biais avant la mise en production de ces outils. En 2023, Google Photos n’était toujours pas capable d’identifier des primates. Mais surtout, cette perspective normalise l’intégration d’outils d’intelligence artificielle qui devient une fatalité avec laquelle il faut composer. C’est sur ce point qu’il faut apporter un peu de nuance.

Vivre sous influence

La critique des biais induits par des outils algorithmiques ne s’arrête pas à leurs données d’entrainement. La force des algorithmes apprenant, à savoir leur capacité à identifier des régularités au sein de bases de données massives, est aussi leur talon d’Achille. Parce que le processus de prise de décision automatisé repose sur l’observation de phénomènes passés, ces dispositifs sont avant tout des outils reproductifs. Cette propriété a de nombreuses vertus pour la prédiction et l’analyse de divers phénomènes « naturels » car ce sont là des évènements qui peuvent se soumettre au calcul, c’est-à-dire que l’enjeu scientifique repose justement sur l’identification des conditions assurant l’apparition de ces phénomènes. Le domaine médical regorge d’exemples où le croisement de données multidimensionnelles (portant sur l’environnement, le régime alimentaire, le patrimoine génétique, etc.) peut permettre d’identifier des régularités qui ne seraient que difficilement observables par d’autres moyens, permettant ainsi de prédire les conditions d’émergence de certaines maladies.

Toutefois, figer le processus décisionnel dans cette posture rétrospective pose un problème lorsqu’il s’agit d’informer une décision humaine dont l’essence repose sur une impossibilité d’optimalité. Dans de nombreux cas, nous devons prendre des choix sur des problèmes qui n’ont pas de solution idéale et ces choix sont les vecteurs d’une identité en formation. Pour reprendre l’exemple de nos algorithmiques de recommandation, en voulant reproduire les régularités identifiées dans le comportement d’un individu, le système va alimenter une boucle rétroactive au sein de laquelle l’utilisateur sera encouragé à reproduire ses habitudes. Si ce mode d’accès à l’information a ses avantages, le développement de ses opinions et de ses goûts est aussi une affaire d’échanges, de discussions, de confrontations, d’errances et, par conséquent, de rupture avec des décisions passées. À un niveau collectif, le recours à l’IA dans le domaine juridique souffre des mêmes écueils.

Un autre problème récurrent avec ces technologies de recommandation concerne leur tendance à polariser les débats. Pour rappel, ces outils reposent sur la maximisation de l’engagement de leurs utilisateurs, identifiée à travers différentes formes d’interaction avec le système. Or, il nous faut faire le constat suivant : ce sont rarement des situations de consensus qui nous poussent à sortir de notre posture de spectateur pour investir l’espace public et partager nos opinions. Les contenus qui sont les plus à même de susciter cet engagement sont généralement des contenus qui provoquent des réactions vives, de la colère, de la frustration, de la tristesse, etc. Poser des garde-fous reviendrait à panser une plaie ouverte. En effet, le système fonctionne et fait ce qu’on lui demande. Le problème ne vient donc pas des données mais de la tâche que doit remplir le système, ce qu’il cherche à mesurer et à optimiser.

Cette question précède et dépasse largement le domaine de l’IA. Quelle que soit sa complexité, tout artefact technique contribue à construire notre rapport au monde et aux autres. Il n’est pas ici question de sombrer dans un déterminisme naïf qui consisterait à affirmer que nous sommes dépourvus d’autonomie. Toutefois, il serait tout aussi erroné de se laisser séduire par le fantasme libéral d’un individu libre et autodéterminé. En imposant certains gestes, en prescrivant divers comportements ou en décourageant l’une ou l’autre pratique, nos objets du quotidien orientent nos actions et notre façon d’appréhender les problèmes mêmes qu’ils essaient de résoudre.

Pour donner corps à ce dernier argument, prenons le cas de la numérisation des points d’accès aux services publics et la réduction progressive des guichets physiques. L’équivalence implicite qui est faite entre un guichet physique et la mise à disposition de formulaires en ligne véhicule l’idée que l’administration, notamment communale, est avant tout une machine bureaucratique qui statue de la conformité de diverses procédures. Si ce n’est pas faux, ce serait oublier qu’il s’agit également d’un lieu de médiation entre le citoyen et l’État, devant permettre au citoyen de discuter, expliquer mais également négocier ou se défendre. Autant d’actions que ne permet pas une page web. Le recours à l’IA comme outil d’accessibilité, via un chatbot [Robot conversationnel NDLR] notamment, est régulièrement envisagé pour pallier cette déficience. Toutefois, en considérant l’état d’avancement relatif de ces technologies et les ressources publiques, il serait prématuré de se priver d’une évaluation critique croisant, d’une part, un diagnostic lucide des besoins du citoyen avec, d’autre part, une évaluation réaliste des limites techniques actuelles.

Par conséquent, l’élaboration d’un dispositif sociotechnique, entendu ici comme un ensemble complexe d’individus, d’objets, de pratiques, d’institutions et de normes sociales ne peut se faire sans prendre en compte l’effet structurel de ces composantes techniques sur les comportements humains. Si vivre sous influence est inévitable, la question qui se pose en amont concerne le type d’influence que nous souhaitons introduire. Lesquelles refuser ? Et selon quelles modalités ? Agir de la sorte implique de penser en termes de problématisation plutôt que de solution. Dit autrement : comment transformons-nous une situation en problème, quelle idéologie est inscrite à travers ce processus et, seulement dans un troisième temps, quels rapports de pouvoir sont instaurés par les solutions envisagées ?

Arnaud Claes est chercheur en Information-communication à l’UCLouvain